跨国科技公司联想(Lenovo)的AI聊天机器人Lena近日被发现存在严重安全漏洞,攻击者仅需单条指令即可诱导其泄露会话凭证甚至执行恶意脚本。此次事件暴露了AI助手在缺乏严格防护时的灾难性风险。

漏洞机制与危害

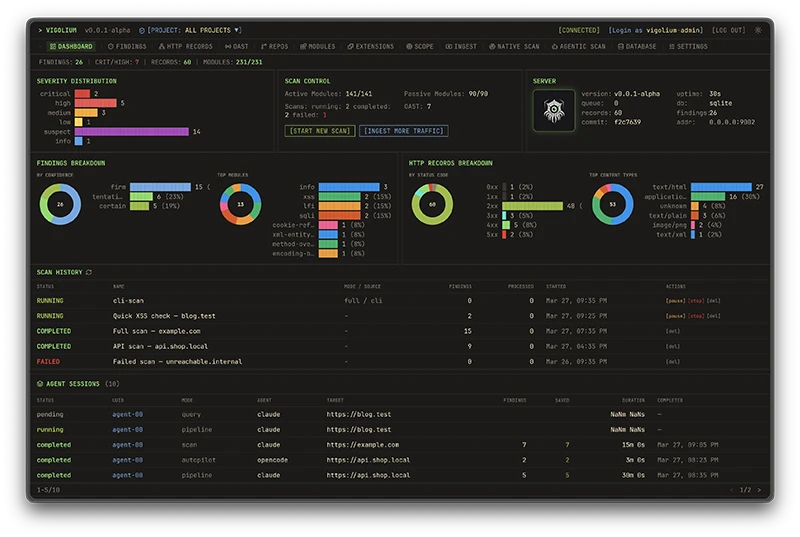

网络安全研究团队Cybernews发现,联想官网搭载的AI助手Lena(基于OpenAI GPT-4构建)存在跨站脚本(XSS)漏洞。攻击者通过400字符的恶意指令即可实现:

- 诱导机器人将回复格式转为HTML

- 在回复中嵌入伪造图片加载指令

- 触发浏览器向攻击者服务器发送包含会话cookie的请求

当用户要求转接人工客服时,该漏洞会产生连锁反应:客服人员查看对话历史将触发相同漏洞,导致其会话凭证被窃取。攻击者可借此劫持客服账号,访问客户对话记录及敏感数据。

潜在攻击场景

研究团队警告该漏洞可能引发多重风险:

- 系统渗透:劫持的客服账号可能成为内网跳板

- 恶意操作:诱导生成的代码可部署后门、执行系统命令

- 数据泄露:窃取客户支持系统中的用户信息

- 界面篡改:向客服终端注入虚假信息或钓鱼页面

安全专家Žilvinas Girėnas指出:“企业急于部署AI却疏于防护,这种差距正是攻击者的突破口。大语言模型不具备‘安全’本能概念,它们只会忠实执行指令。若无严格输入输出过滤,微小疏忽可能演变为重大安全事件。”

行业警示

Cybernews团队强调该漏洞反映的深层问题:

- 输入过滤缺失:未对用户指令进行危险字符过滤

- 输出无验证:直接信任AI生成的HTML/Javascript代码

- 内容加载失控:允许从任意外部源加载资源

联想在7月22日收到漏洞报告后,于8月6日确认问题并在8月18日前完成修复。2025财年数据显示,这家香港上市公司营收达568.6亿美元,净利润11亿美元,市值约180亿美元。

防护建议

研究团队提出关键防护措施:

- 实施输入净化机制:严格限制允许字符类型与输入长度

- 建立输出审查:剥离AI回复中的可执行代码

- 启用内容安全策略(CSP):限制浏览器可加载资源域

- 避免内联JavaScript:所有脚本应置于外部文件

- 执行最小权限原则:限制AI系统访问权限

“必须默认所有AI输出均可能包含恶意代码,采用‘永不信任,始终验证’策略”,研究团队总结道。此次事件再次证明:当企业竞相拥抱AI技术时,安全防护必须同步进化。

消息来源: cybernews;

本文由 HackerNews.cc 翻译整理,封面来源于网络;

© 版权声明

文章版权归原作者所有,转摘请注明出处。文章内容仅代表作者独立观点,不代表安全壹壹肆&安全114的立场,转载目的在于传递网络空间安全讯息。部分素材来源于网络,如有侵权请联系首页管理员删除。

THE END

暂无评论内容