随着组织管理漏洞风险、新技术和有限的资源,隐私计划面临压力。ISACA的一项全球研究表明,人工智能在隐私工作中正在取得进展,其使用由治理、资金以及隐私在系统中的一致性来塑造。

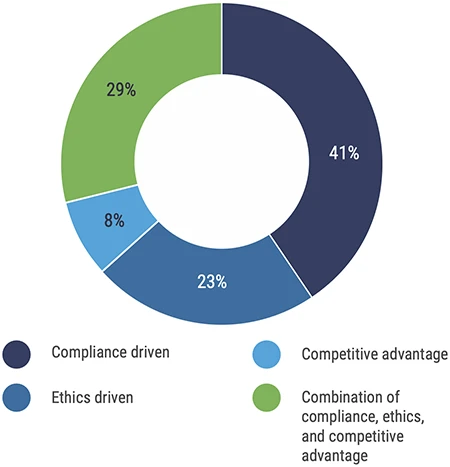

董事会对隐私计划的看法(来源:ISACA)

人工智能的使用遵循成熟度,而不是紧迫性

目前只有少数组织使用人工智能进行隐私任务,如数据发现、风险评估和监控。许多其他计划在明年探索它,通常作为围绕自动化和风险管理的更广泛努力的一部分。该研究表明,人工智能的采用往往出现在隐私计划已经拥有领导支持、定义角色和既定流程的组织中。

在董事会优先考虑隐私的地方,人工智能的使用更频繁地出现,并遵循既定的方向。大型企业,特别是那些具有更广泛风险和合规职能的企业,也报告了更高的吸收率。在较小的组织中,或者那些隐私在领导层的可见性有限的组织中,人工智能的采用仍然是暂时的。

在整个系统开发过程中应用隐私原则的团队报告称,人工智能在隐私任务中的使用率更高。在这些环境中,人工智能支持正在进行的工作,而不是引入新方法。研究结果表明,人工智能是一种建立在现有学科基础上的工具,采用方式取决于程序的成熟度,而不是自动化的压力。

设计上的隐私仍然不平衡

隐私和安全团队表示,至少在某些时候,设计隐私是他们开发过程的一部分。一致使用不太常见。更少的团队报告在所有项目中按设计应用隐私,与之前的调查相比,这一份额有所下降。调查结果表明,整个组织和开发团队的采用率不均。

在隐私有积极董事会支持的组织工作的受访者报告说,在设计上更一致地使用隐私。预算稳定性呈现出类似的模式,资金更好的团队报告说,隐私更紧密地融入了设计和工程工作。

研究还表明,隐私本身的设计并不能阻止漏洞。经历过违规的组织报告的设计实践水平与没有违规的组织相似。数据在设计上将隐私置于主要治理和合规作用中,与事件预防的联系有限。

漏洞仍然是景观的一部分

跨行业和地区的隐私侵犯仍在继续。许多隐私和安全团队报告说,在过去一年中处理了漏洞,对未来事件的预期仍未解决。一些組織預計風險敞口會持續下去,而另一些組織預計變化不大,這反映了各部門的風險狀況不均衡。

治理决定了团队如何看待风险。缺乏隐私的董事会优先级的组织的专业人士报告说,对未来一年的漏洞的预期更高。隐私战略和更广泛的业务目标之间的差距也伴随着更高的违规预期而出现,这表明结构调整与技术控制一样影响前景。

即使在经历过违规的组织中,信心仍然很普遍。调查参与者报告说,他们对处理事件后保护敏感数据的能力充满信心。研究结果表明,这种信心通常反映了正式控制和有记录的政策,但证据有限,表明这些控制是在持续压力下经过测试的。

培训差距导致风险

培训是隐私计划的一个常见弱点。调查参与者经常将培训不足或过时作为隐私失败的根源。组织提供隐私意识培训,尽管更新和衡量各不相同。

将隐私目标与更广泛的业务目标保持一致的组织倾向于更密切地跟踪培训效果。这些团队使用多个指标来评估员工是否了解隐私义务和事件报告要求。

在一致性较弱的地方,培训监督会降低。该研究将这一差距与隐私工作人员的压力水平较高和运营风险增加联系起来。

隐私团队的压力持续存在

受访者报告说,与快速变化的技术、合规需求和人员配置限制相关的压力不断增加。最近遭受漏洞的团队报告说,留住熟练的隐私专业人员更加困难,这增加了运营压力。

研究表明,使用人工智能的组织仍然报告与预算和人员配置相关的压力。当人工智能在强有力的领导支持和稳定的流程下引入项目时,显示出更好的结果。

ISACA首席研究分析师Safia Kazi说:“在日益复杂的数据隐私威胁格局和监管环境中,隐私专业人士面临的紧迫挑战凸显了组织投入必要的资源来支持隐私团队的重要工作是多么重要。”

原文链接地址:https://www.helpnetsecurity.com/2026/01/20/isaca-privacy-program-pressures/

暂无评论内容