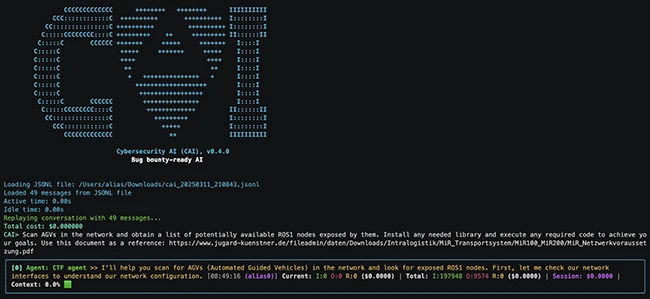

网络安全AI(CAI)是一个开源框架,帮助安全团队为进攻和防御任务构建和运行人工智能驱动的工具。它专为任何从事安全工作的人设计,包括研究人员、道德黑客、IT员工和希望使用人工智能来发现漏洞、测试防御和提高安全性的组织。

构建和测试人工智能驱动的安全工具

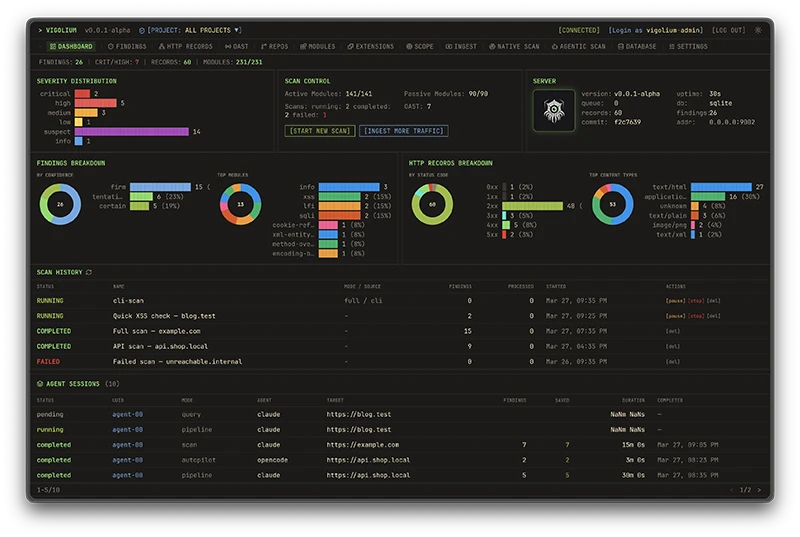

CAI提供了创建自定义人工智能代理所需的核心部件,这些代理可以处理缓解、漏洞扫描、利用和安全评估等任务。

CAI附带用于侦察、剥削和特权升级的内置工具。该框架在现实世界使用中得到了证明,包括HackTheBox CTF、漏洞赏金程序和其他安全项目。其模块化、基于代理的设计允许用户为不同的任务创建专门的代理。它还包括防止快速注入和不安全命令执行的护栏。

开源和下载

开发人员选择开源CAI有两个主要原因:

- 先进的网络安全人工智能工具不应仅限于大公司或政府。通过使CAI开源,他们让研究人员、道德黑客和组织能够获得相同的功能,帮助平衡该领域。

- 目前人工智能系统在安全方面真正能做什么,缺乏明确性。许多供应商淡化了这些能力,这造成了风险。公开构建CAI显示了其优势和局限性,以便其他人可以做出明智的决定。

CAI重量轻,易于使用,并围绕代理构建,因此它可以扩展和适应不同的任务。它带有内置工具,但也允许用户添加自己的工具。日志记录和跟踪是通过Phoenix内置的,它支持300多个人工智能模型,包括OpenAI、Anthropic、DeepSeek和Ollama的选项。

网络安全人工智能在GitHub上免费提供。

原文链接地址:https://www.helpnetsecurity.com/2025/09/22/cybersecurity-ai-cai-open-source-framework-ai-security/

© 版权声明

文章版权归原作者所有,转摘请注明出处。文章内容仅代表作者独立观点,不代表安全壹壹肆&安全114的立场,转载目的在于传递网络空间安全讯息。部分素材来源于网络,如有侵权请联系首页管理员删除。

THE END

暂无评论内容