以开发者为中心的开源AI安全护栏平台

让AI安全合规,畅行全球

一、划时代的突破:首个完全开源的AI安全护栏系统

在AI安全日益重要的时代,象信AI正式发布全新力作——OpenGuardrails:全球首个同时开源护栏大模型与安全护栏代码的AI安全平台。

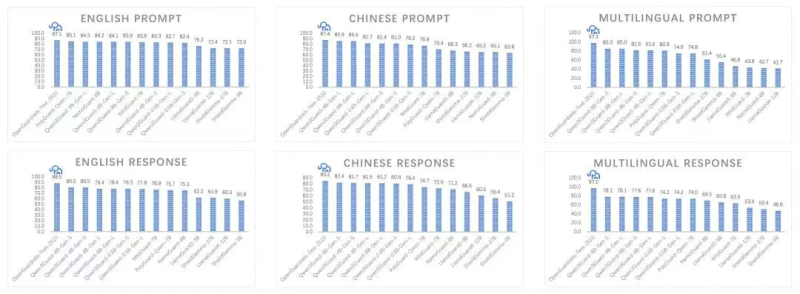

OpenGuardrails不仅在安全模型性能上全面超越行业标杆(包括Qwen3Guard、LlamaGuard、WildGuard、ShieldGemma、NemoGuard、PolyGuard等), 更在英文、中文、多语言场景中实现了全线SOTA(最先进)表现, 一举成为新的AI安全护栏大模型之王。

📊 性能对比一览(平均F1得分,数值越高表现越好)

![图片[1]安全114-安全在线-安全壹壹肆-网络安全黄页-网络安全百科OpenGuardrails:AI安全护栏大模型新王!](https://www.anquan114.com/wp-content/uploads/2025/10/20251024091158192-image-1024x376.png)

📈 技术报告(arXiv):https://arxiv.org/abs/2510.19169

OpenGuardrails采用统一LLM架构,结合上下文理解、内容安全、模型操控检测与数据泄露防护, 是首个可落地、可部署、可二次开发的安全护栏基础设施。 其推出,标志着象信AI在安全模型训练能力与AI安全体系建设上达到全球领先(SOTA)水平。

二、技术革命:从“规则防护”到“智能护航”

与以往的规则式内容审核不同,OpenGuardrails创新引入——

🌐 统一大模型架构

单一大模型同时完成:

- 内容安全检测(有害/违法/不良内容)

- 模型操控防御(Prompt Injection、Jailbreak防护)

- 数据泄露识别与脱敏

⚙️ 动态可配置安全策略

每个API调用都可自定义“安全类别”与“灵敏度阈值”, 在不同国家、行业或场景中灵活适配,真正实现按需调控的AI安全防护体系。

🔢 可微分的安全决策机制

相较Qwen3Guard的固定“严格/宽松模式”, OpenGuardrails支持连续的敏感度阈值调节(τ ∈ [0,1]), 通过数学化的概率推理实现更平滑、更智能的安全判定。

🧠 多语言与跨文化适配

支持119种语言与方言,覆盖中英日韩、阿拉伯语及欧洲全语系, 助力AI产品无障碍进入全球市场。

三、象信AI全球战略全面启动 🌍

OpenGuardrails不仅是一项技术创新,更是象信AI全球化布局的重要一步。

我们宣布:象信AI正式启动海外市场开拓计划, OpenGuardrails将面向全球开发者开放, 提供开源模型、API接口与企业级私有化部署方案, 支持开发者快速实现全球范围内的AI安全合规。

四、开发者福利:一站式AI安全与合规基础设施

🇨🇳 中国市场

- 🏛️ 助力大模型备案合规自动检测与拦截违规内容,深度适配《生成式人工智能服务管理暂行办法》。

- ⚡ 备案提速与商业化加速提供标准合规模板与行业安全规则,加速AI产品安全落地。

🌍 全球市场

- 🌐 适配全球法规体系支持《EU AI Act》《GDPR》《AI Bill of Rights》等国际标准。

- 🧩 本地化合规支持根据不同地区宗教、文化与语言标准提供智能内容过滤。

- 🔒 隐私与数据安全全程合规的数据最小化与跨境传输保护。

OpenGuardrails:让AI安全合规,畅行全球 新一代 AI 安全与合规基础设施,专为大模型开发者与企业打造。

五、开放共建:全面开源,共创安全AI未来

OpenGuardrails项目已在多平台上线:

- 🌐 官网:https://openguardrails.com

- 💻 GitHub:https://github.com/openguardrails/openguardrails

- 🤗 HuggingFace:https://huggingface.co/openguardrails

模型与平台均采用 Apache 2.0 许可协议全面开放, 欢迎全球开发者共同构建安全、可信、可持续的AI生态。

✨ 象信AI的愿景

“让安全不是阻碍,而是加速。”

OpenGuardrails的发布,不仅是技术上的超越, 更是象信AI在全球AI安全基础设施领域的一次宣言——中国力量,引领全球AI安全新标准!

📢 关注象信AI公众号第一时间获取 OpenGuardrails 最新模型更新与企业合作计划。

暂无评论内容