![图片[1]安全114-安全在线-安全壹壹肆-网络安全黄页-网络安全百科AI风险管理缺失的一环,AIBOM&SBOM](https://www.anquan114.com/wp-content/uploads/2025/04/20250416125255813-image.png)

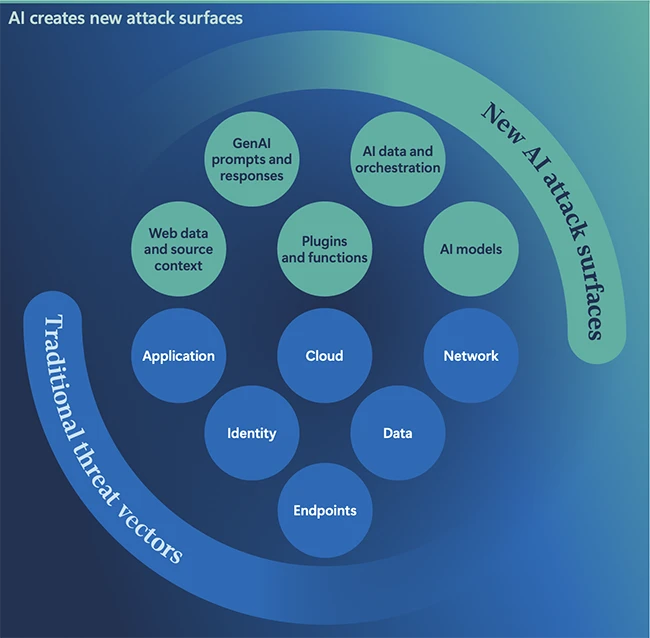

本文从人工智能盛极一时的阶段讨论了被忽视的特定于AI的风险(如中毒的训练数据和影子AI)如何导致传统工具无法检测到的安全问题。比如AI物料清单(AIBOM)是如何扩展SBOM(软件物料清单),以提供数据集、模型权重和第三方集成的透明度,从而改进治理和事件响应。

先从实际的案例分析解释下AI 供应链的安全问题。

传统的工具忽视了特定于AI的风险(如中毒的训练数据、模型漂移或影子AI的使用),而这些风险后来却成为了重大的业务或安全问题?

比如:LAION-5B的情况就是一个非常典型的例子。LAION-5B是一个庞大的包含58.5亿个图像-文本对的数据集,它成为了Stable Diffusion、DALL-E 2等极受欢迎模型的基础,也是当今企业使用的无数其他图像生成系统的基础。斯坦福大学的研究人员发现,LAION-5B中包含了大约1600个儿童性虐待材料实例,这些材料是从互联网上未经适当过滤而抓取来的。可怕的是,这不仅仅是一个数据集问题。每一个在LAION-5B上训练的AI模型都可能继承了这些中毒数据,而传统的安全扫描工具根本无法检测到它。

更为严重的是当LAION-5B问题暴露时,大多数公司没有系统的方法来追踪他们的哪些应用程序受到了影响。他们无法对一些基本问题做响应,比如“我们组织中的任何地方是否使用了Stable Diffusion?”或“我们的哪些应用程序可能会受到影响?”大多数组织甚至无法确定哪些应用程序包含了受影响的模型,更不用说追踪数据谱系回到原始训练集了。

对于AIBOM在结构和功能上与传统SBOM有何不同?对于首席信息安全官(CISO)来说,哪些组件(如训练数据集、模型权重或第三方API)是最关键需要追踪的?针对这个我们也来分享下AIBOM在实质上提高了透明度或事件响应的用例。

AIBOM遵循与传统SBOM相同的格式,但包含特定于AI的内容和元数据,如模型系列、可接受用途、特定于AI的许可证等。作为是一家大型国防承包商的安全负责人,就需要能够识别模型开发者及其原产国家。这里面考虑的重要是地缘政治因素了。

早期采用者,特别是在金融、医疗保健或关键基础设施等领域,已经在AIBOM使用体验、业务经营管理等诸多方面建立了良好的效果。

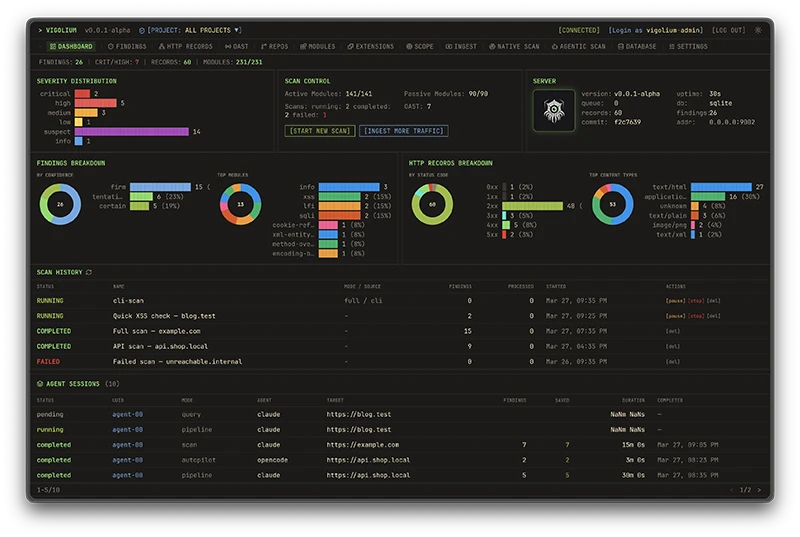

首先,最重要的是显著减少了批准模型所需的时间和精力。在当今的典型企业中,如果开发人员想使用新模型,请求需要经过一个审查批准流程,可能需要数周的时间。这个审查过程必须由经验丰富且有价值的团队或团队成员来进行。利用AIBOM并执行公司政策可以自动将这个问题简化为两步操作。

其次是治理。早期采用AIBOM的企业可以在几秒钟内回答诸如“我们是否在任何地方使用了DeepSeek?”或“我的模型是否存在知识产权风险?”等问题。

最后是安全。当出现LAION-5B类型的情况,或DeepSeek,或不可避免的下一个AI安全威胁时,采用AIBOM的企业的补丁平均时间和修复平均时间将比没有AI库存的企业低几个数量级。

作为公司的管理人员获取实时明确的信息至关重要,我们可以先从基础问题清单开始,比如

“我们的任何模型是否来自中国、俄罗斯或伊朗?”

“我们的任何AI是否建立在不再受支持的传统模型之上?”

“我们是否有权在我们的行业中使用这些模型和数据集?”

“我们的任何AI是否随附软件漏洞?”

“我们所有模型和数据集的完整库存在哪里?”

一旦你掌握了这些基础知识,那么就该开始提出更高层次的问题了,比如:

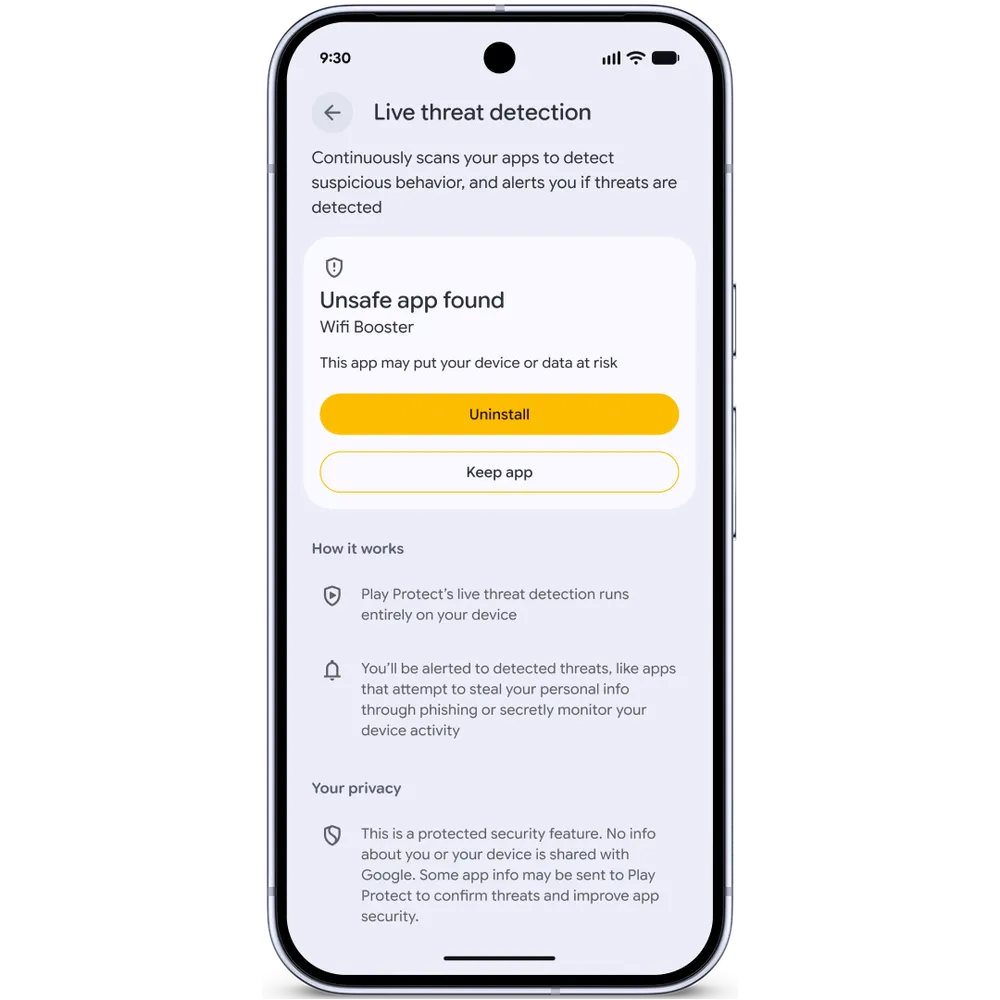

“我们的流程是什么,以确定开发人员代码中的影子AI?”

“我们针对这些新兴法规的合规流程是什么?”

“如果我们发现中毒的数据集或模型,我们的响应时间会是多久?”

今天,大多数公司管理层都无法回答这些基本问题,因为在AI方面缺乏了透明度,所以说能够快速精准确认这些问题的组织具有巨大的竞争优势,这使得我们可以更快地部署AI,精确响应事件,并在不中断运营的情况下保持法规合规性。

高管级别的可见性与技术报告之间的区别在于:高管需要了解业务影响和风险优先级,而不是漏洞数量。企业可以通过一些必要的AIBOM管理步骤来发现和管理隐藏的AI资产。

第一步是对他们的AI进行库存管理。利用AIBOM对AI依赖项进行库存管理,监控已批准、已请求和被拒绝的内容清单,并确保对每个清单内容都有所了解。

第二步是主动寻找AI,而不是等待员工去发现它。组织需要具备在代码中识别AI并自动生成相应的AIBOM的能力。

第三步是制定和采用负责任的AI政策。其中一些政策是相当常识性的:不接受来自外国资产控制办公室制裁国家的贡献者,不接受copyleft许可证,不使用在HuggingFace上没有三个月跟踪记录的模型,以及不使用超过一年未更新的模型。然后,在一个自动化且可扩展的系统中执行这些政策。

我们的关键目标是从被动发现转变为主动监控。大多数组织只有在出现问题或进行手动审计时才发现AI的使用情况。到那时组织已经面临风险了,而自动检测和策略执行将AI治理从合规性练习转变为智能化运营,进一步实现更快、更安全的AI应用用。

参考原文链接:https://www.helpnetsecurity.com/2025/08/04/marc-frankel-manifest-cyber-aiboms-sboms/

暂无评论内容